作者:赵子昂 田喆 姚旭 发布时间:2023-07-29 来源🧖🏿:富达平台中美友好互信合作计划+收藏本文

一、拜登携手AI巨头的“承诺”

白宫在7月21日的周五宣布,拜登政府已与七家制造人工智能产品的公司达成协议,以制定旨在自愿确保AI技术安全开发的指导方针。拜登在当天下午对媒体表示:“这些承诺是真实的🔇👳🏿♂️,而且是具体的”🤾🏻♂️,“AI行业将履行其对美国人民的基本义务🕶,即安全开发、可靠和值得信赖的技术,而该技术能造福社会并维护我们的价值观和我们共同的价值观👩🏻🦼。”

拜登在白宫罗斯福厅发表讲话👯。左起为亚马逊网络服务首席执行官亚当·塞利普斯基、 OpenAI总裁格雷格·布罗克曼、Meta总裁尼克·克莱格、Inflection AI首席执行官穆斯塔法·苏莱曼🙅🏼,图源:美联社

创造ChatGPT的公司OpenAI在一份声明中表示,“这一过程由白宫协调,是在美国和世界各地推进有意义和有效的人工智能治理的重要一步。”

参与此次活动的公司包括Amazon、Anthropic、Google🧒🏽⚔️、Inflection、Meta🤲🏻、Microsoft和OpenAI🧑🏻🦯➡️。其中,Anthropic由Daniela Amodei和Dario Amodei兄妹创立,两人此前由OpenAI研究主管的职位上出走,原因是无法接受OpenAI抛弃“初心”。

事实上,Anthropic虽声称自己依然是非营利性组织🧎🏻,但与OpenAI类似的是,也与巨头进行了某种形式上的绑定。Anthropic已与谷歌建立了合作伙伴关系,以访问谷歌的云计算,其开发的大语言模型Claude 2 正在对标OpenAI的GPT 4📂。

这些公司都在开发大语言模型(LLM)的进程中各有特色。大语言模型因其使用海量的语言文本进行机器训练👨🏽🦳🚶🏻♀️➡️,且这些文本通常取自可公开访问的互联网,并使用预测分析来对话式地响应查询,几个月以来持续受到全球各国人工智能监管与治理的高度关注。

美国副总统哈里斯曾于5月4日在白宫接待Google、Microsoft、OpenAI和Anthropic的首席执行官们,讨论人工智能相关风险。ChatGPT横空出世🚛,风口浪尖上的AI革命引发了全球科技和金融热潮。伴随着生成式人工智能的军备竞赛与飞速扩张🧎🏻♂️➡️,对于人工智能可能给社会和人类带来危机的担忧也不断增长🪼✈️。于是,在愈来愈强烈的社会呼吁中,政府开始思考并尝试对这些新技术进行监管🍅,推动社会治理。

美国国会众议院军事委员会下属的网络、信息技术与创新小组委员会(CITI)周二(7月18日)举行一场名为“人与机器:战场上的人工智能”的听证会🏊🏼。听证会探讨三个主题👩🏼🦲,包括美国国防部采用人工智能的现状、哪些结构性障碍阻碍了军队对人工智能更广泛应用及使用上的采纳🛀🏽、美国的潜在对手如何在战场上运用人工智能对抗美国。

Anthropic 首席执行官 Dario Amodei 以及教授 Yoshua Bengio 和 Stuart Russell 在周二参议院人工智能听证会上宣誓➛,图源:GETTY

根据《华盛顿邮报》报道,7月25日有三位AI领域领军人物在国会听证会上作证,警告人工智能的疯狂发展速度可能会在未来几年内导致严重危害,例如流氓国家或恐怖分子利用该技术制造生物武器。被称为现代人工智能科学之父之一的蒙特利尔大学人工智能教授 Yoshua Bengio表示,美国应推动国际合作来控制人工智能的发展,并概述了类似于核技术国际规则的制度🥟。Anthropic的Dario Amodei作为CEO表示👨👩👧👧🆓,他担心尖端人工智能可能会在短短两年内被用来制造危险的病毒和其他生物武器。加州大学伯克利分校计算机科学教授Stuart Russell表示🌔,人工智能的工作方式意味着它比其他强大的技术更难完全理解和控制❇️🛌。

目前♟🖕,不同国家和地区的政府采取了哪些措施管控AI风险、制定政策🧾?在这个过程中🧑🍳,政治的博弈和竞逐将以怎样的形式展开?本文希望基于对世界上主要国家和地区对生成式人工智能的监管和治理的梳理,反思和展望未来人工智能监管的走向和对现有权力体系的影响🤦🏼♀️。

二、世界主要国家和地区现有AI治理政策

中国💂:全球第一个出台正式法律

4月11日,中国国家互联网信息办公室发布《生成式人工智能服务管理办法(征求意见稿)》,这被视为中国在人工智能监管层面的最新动作。对此🤹♀️,主打科技评论的媒体Axios指出,尽管华府一直担心中国的人工智能技术超越美国🕤👨🏻⚕️,但政府更应注意,中国在人工智能监管方面早已“遥遥领先”💌。Axios梳理了过去中国出台的诸如《新一代人工智能伦理规范》(2021)《个人信息保护法》(2021)等相关规范👛,认为,“如果中国能率先进行人工智能治理,它就可以在全球范围内推广这些标准和法规,塑造利润丰厚且灵活的市场”。

在广泛征求各界意见后,《生成式人工智能服务管理暂行办法》于7月13日正式出台,坚持发展和安全并重👰🏽♂️💂🏻、促进创新和依法治理相结合的原则,采取有效措施鼓励生成式人工智能创新发展,对生成式人工智能服务实行包容审慎和分类分级监管,明确了提供和使用生成式人工智能服务总体要求。《生成式人工智能服务管理暂行办法》的出台,使中国成为全球范围内首个在法律规制层面明确提出生成式人工智能治理方案的主要行为体。

美国:整体立法相对缺失

除中国外🕺,美国也对人工智能高度关注🧔🏿,但立法层面相对缺失🙅🏿,而以争论🕚、调查居多🚙。规则制定层面😞,今年年初以来,仅有美国国家标准与技术富达平台(NIST)于1月发布了《人工智能风险管理框架》(AI RMF)1.0版,可供相关组织设计和管理的可信赖和负责任的人工智能,旨在指导机构组织在开发和部署人工智能系统时降低安全风险🧝🏻♂️,避免产生偏见和其他负面后果🦹🏼♂️😣,提高人工智能可信度🌓;4月28日,由美国三名民主党人和一名共和党人组成的小组在众议院提出了一项法案,旨在防止人工智能(AI)系统发展到可以自主发动核攻击的程度🔵;以及5月5日新版全规则提出对“人类作者身份”的人工智能作品进行保护。

不过🐱,美国各界对于人工智能的担忧与争论十分激烈🧔🏽,3月10日,美国商会(U.S. Chamber of Commerce)呼吁政府对人工智能技术进行监管,以确保它不会损害经济增长或威胁国家安全;3月21日,纽约大学教授马库斯警告人工智能可能在选举中制造虚假信息,这一担忧在4月拜登宣布竞选连任后,共和党发布由人工智能生成的反击视频得到部分印证;3月29日,生命未来研究所(Future of Life Institute)公布一封公开信🕝,呼吁所有AI实验室立即暂停训练比GPT-4更强大的AI系统至少6个月💫,马斯克等人签署了这封公开信;3月31日🤹🏻♀️🪗,美国国会就是否应该暂停高级人工智能训练展开讨论。

4月1日,科技伦理组织人工智能和数字政策中心(Center for Artificial Intelligence and Digital Policy😵💫,简称CAIDP)要求美国联邦贸易委员会(Federal Trade Commission🏃🏻➡️,简称FTC)阻止OpenAI发布GPT-4的新版本;4月8日💝,在与科学技术顾问委员会的一次会议上📀,美国总统拜登表示,人工智能可能是危险的⚽️,并敦促科技公司在公开产品之前确保其产品安全;4月12日,美国商务部国家电信和信息管理局(National Telecommunications and Information Administration,简称NTIA)希望公众参与开发人工智能审计🙆♀️、评估、认证和其他工具👱🏿♀️,以建立公众的信任,这是朝着联邦层面潜在的人工智能法规迈出的第一步。

5月9日,美国作家协会(WGA)已罢工近一周🌻,要求确保人工智能不会抢走编剧的报酬和功劳🧏🏽♀️;与美国类似,5月8日,日本艺人协会在东京举行记者会,称人工智能的发展导致许多人面临失业风险🧛🏻♀️,协会当天亦向日本文化厅等政府机构上交请·愿书,要求完善相关法律,加强权利保护措施🤶🏼🏂🏻。

司法🥻、审查与管理层面主要集中在4月以来,4月10日,美国商务部(US Commerce Department )下设机构国家电信和信息管理局(National Telecommunications and Information Administration🧻,以下简称“管理局”)展开调查,聚焦公司和监管机构如何确保人工智能系统可信度、合法性、且符合道德,重点关注审计人工智能系统的最佳方法,并最终为白宫和国会提出政策建议🚡;4月18日,美国联邦贸易委员会(U.S. Federal Trade Commission,简称FTC)在国会听证会表示,将追查滥用人工智能违反反歧视法律或具有欺骗性的公司。

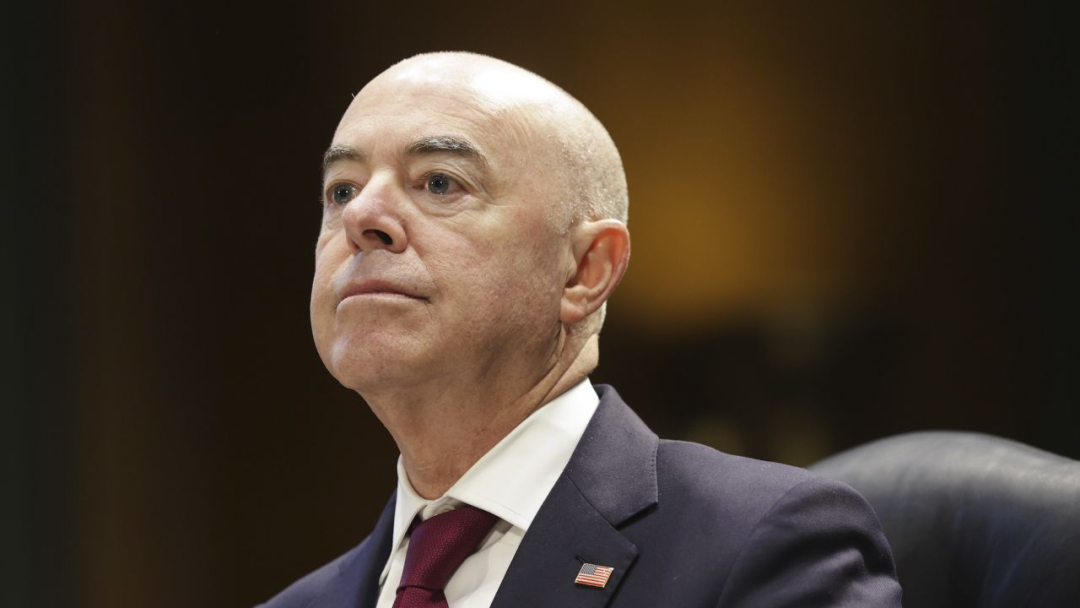

4月20日🧑🏻💼,美国央行高级官员表示🖖,随着越来越多的金融机构在在客户服务应用、欺诈监控🐼👨🏼🌾、承销方面运用人工智能,美联储与其监管的银行就管理人工智能相关风险进行了“定期讨论”;4月21日,美国国土安全部(U.S. Homeland Security)部长马约卡斯(Alejandro Mayorkas)表示,将成立人工智能特别工作组(Artificial Intelligence Task Force),研究如何使用人工智能来完成从保护关键基础设施、筛查非法货物、查找奴隶劳工制造产品等工作,并敦促使用人工智能来保护电网和供水系统🫷🏼;4月25日,美国多部门表示将着重确保人工智能不侵犯公民权利;同日,美国最高法院拒绝为人工智能辅助生成作品授予专利;不过在5月5日,新的美国版权规则保护具有“人类作者身份”的人工智能艺术🦒。

美国土安全部部长马约卡斯,图源🧔🏻♂️⛸:CNN

欧盟与欧洲国家:加速立法与审慎监管

欧盟(包括成员国)方面,人工智能的发展也带来了一定程度的混乱与争论,但总体而言加速了相关立法进程。最新的消息表明,欧盟《人工智能法案》(Artificial Intelligence Act)很有可能在今年年末即宣告正式出台🩱。

从今年年初始,据POLITICO报道,ChatGPT的卓越表现已经颠覆了欧盟委员会(European Commission)、欧洲议会(European Parliament)和欧盟理事会(Council of EU)为欧盟人工智能规则手册草案《人工智能法案》所做的工作,并促使有关机构重新审视有关人工智能监管的法案。3月22日,路透社又报道称随着人工智能蓬勃发展,欧盟立法者为新法规而争吵;3月31日,意大利更是因涉嫌违规行为为由封锁ChatGPT,这一禁令直到4月28日,在OpenAI回应监管机构后,意大利方解除对ChatGPT的禁令👯♂️;

除意大利外,4月11日,法国隐私监管机构CNIL介入调查有关 ChatGPT 的投诉🏄🏼♀️;4月12日,西班牙要求欧盟数据保护委员会讨论 ChatGPT👩🏼🍳;作为对有关争论的回应,4月13日👩🦯,欧洲数据保护委员会(EDPB)成立了ChatGPT专门工作组,但据Euractiv4月14日报道则称🧗🏼♂️,欧盟议会在人工智能法案的制定上分歧重重💂🏽♀️;4月19日🏌🏻,欧盟委员会(The European Commission)成立了一个新的研究部门欧洲算法透明度中心(The European Centre for Algorithmic Transparency🧃,简称ECAT),该研究部门的任务是审核谷歌和 Meta 等大型科技公司使用的 AI 支持算,从而帮助欧盟委员会识别和解决这些平台带来的任何潜在风险。

4月19日,欧盟委员会成立欧洲算法透明度中心👱🏼,图源:EURACTIV

4月20日,爱尔兰数据监管机构则称无需急于禁止聊天机器人;4月24日🖋,德国监管机构对 ChatGPT 的《通用数据保护条例》(GDPR)合规性展开调查;同日🕋,欧洲消费者组织敦促欧盟消费者保护机构调查ChatGPT;4月26日🫵,西班牙提出➰,希望在其担任欧盟轮值主席国期间建立欧盟的人工智能监管法规。

4月27日🚵🏼♂️,据路透社报道,欧盟的人工智能监管取得较大进展🫓,根据欧盟初步达成的一项协议,部署ChatGPT等生成式人工智能工具的公司必须披露用于开发其系统的所有受版权保护的材料,该协议可能为全球首个管理人工智能技术的全面法律铺平道路。

英国方面,早在3月29日,随着 ChatGPT的迅速扩展✡︎✦,英国政府敦促监管机构制定人工智能规则🍮,但是选择“适应性强”的人工智能规则🆚,不设立单一的监管机构🥢👨🏻🎤;4月24日,英国更是成立了1.25亿美元的工作组来推动本国人工智能的发展👦🏿;5月4日‼️,英国竞争监管机构表示,将开始研究人工智能对消费者、企业和经济的影响🎺🦻🏽,以及是否需要新的控制措施🤷🏿。

5月18日,泰晤士报报道🫸🏿,英国首相苏纳克在G7峰会前呼吁🧝🏻,需要“护栏”以规范人工智能,苏纳克警告称,人工智能正在迅速发展👰♀️,希望“确保我们的监管也能像现在这样发展”🧑🎤🏌🏽♂️。不过🧝🏿♀️,《纽约时报》评论称,目前尚不清楚G7领导人“能否就一项如此迅速出现的技术进行(有效)对话”。对此,一些美国官员称,就聊天机器人而言🟪,即使模糊的讨论也可能助于建立一些共同原则,亦可便利下级人员进一步讨论实施细节,例如,制造这些大语言模型的公司将对其安全性负主要责任👸🏼,且必须有透明度规则等。

5月18日,英国首相苏纳克在G7峰会前召开发布会,图源🤽🏻♂️:inews

一些声音呼吁召开世界性的峰会,集中讨论人工智能监管问题👨🏽🍼。4月17日,路透社报道,欧盟议员呼吁召开世界领导人峰会以控制“非常强大的”人工智能👷🏻♀️,敦促世界各国领导人召开峰会寻找控制ChatGPT等先进人工智能系统发展的方法,并表示人工智能系统的发展速度比预期的要快。目前,12名欧洲议会议员已致力于欧盟关于该技术的立法工作,他们呼吁美国总统乔·拜登(Joe Biden)和欧盟委员会主席乌苏拉·冯·德莱恩(Ursula von der Leyen)召开此次会议,并表示人工智能公司应该肩负起更大的AI相关责任;不过这一呼吁得到的回应并不热烈🙋♂️。

日本、俄罗斯🤸♂️、印度

4月10日,路透社报道,在OpenAI首席执行官阿特曼访日并与岸田文雄会面后,日本内阁官房长官松野博一表示🐄,首相岸田文雄和阿特曼就人工智能的技术进步和优点以及隐私和侵犯版权等风险交换了意见👨🏻🎨,日本将评估引入 OpenAI 的 ChatGPT 聊天机器人等人工智能技术的可能性💆🏿👩👩👦,因为它会检查收益和风险🤦🏽♂️👂,同时💁🏿♀️,日本将在评估如何应对数据泄露等问题后,继续评估引入人工智能以减少政府工作人员工作量的可能性🛏。

今年以来,俄罗斯的人工智能监管由于战争背景,以审查为主。1月9日🧛🏼♀️,《莫斯科时报》(The Moscow Times)称,俄国执政党正在用人工智能清除反战选民;2月18日🫲🏽,俄罗斯推出 AI 监控工具 Oculus 以加强其网络审查手段;4月24日,俄罗斯银行Sberbank发布了对标ChatGPT的GigaChat♥️。

相比之下,4月5日,印度电子和信息技术部在一份长篇书面回应中表示,印度已经评估了与人工智能相关的道德问题和偏见和歧视风险,暂时不打算对人工智能进行监管。

G7广岛峰会

5月20日Ⓜ️,G7广岛峰会领导人公报发布,在人工智能问题上🟢💃🏽,G7领导人认为,应“推进关于包容性人工智能治理和互操作性的国际讨论,以实现我们对可信赖的人工智能之共同愿景和目标☁️,(并使人工智能)符合我们共享的民主价值观“🚴🏽♂️。

在峰会期间,G7领导人表示,“需要立即评估生成人工智能的机遇和挑战”👩👦,还呼吁制定和采用技术标准,以保持人工智能“值得信赖”,称该技术的治理未能跟上其成长。领导人还敦促经济合作与发展组织等国际组织对(有关人工智能)政策的影响进行分析。

在此之前的4月30日,七国集团(G7)的数字监管领域部长们(Digital ministers)在日本举行了为期两天的会议👰🏿♂️,并在会议结束时发表联合声明🎐,一致同意G7发达国家应“基于风险”进行人工智能监管,但这种监管也应该为人工智能技术的发展“保持开放和有利的环境”🙆🏿,并以民主价值观为基础,“实现可信赖人工智能的共同愿景和目标的政策工具可能因G7成员而异”。路透社评论道,该协议为主要国家如何在隐私问题和安全风险中治理人工智能设定了一个里程碑🈹。

总体而言,G7 国家表示他们“计划召集在未来的G7会议上讨论生成式人工智能,其中可能包括治理、如何保护包括版权在内的知识产权📠、提高透明度🫅🏼、解决虚假信息”等主题,包括外国势力的信息操纵。部长们还讨论了为“具有信任的数据自由流动系统”或 DFFT创建标准规则的计划。DFFT概念于2019年在世界经济论坛上提出,旨在促进基于信任的跨境数据传输。

4月30日,G7数字监管领域部长们在日本举行了为期两天的会议⛔,图源:Reuters

虽然承认在如何监管人工智能方面存在分歧,但G7集团领导人同意在今年年底之前创建一个名为“广岛人工智能进程”(Hiroshima AI process)的部长级论坛,讨论围绕生成人工智能的问题,例如版权和虚假信息。

G7广岛峰会领导人合影🤹♂️,图源:g7hiroshima.go.jp

三、ChatGPT后AI治理的趋势

监管责任与风险共担

在当前人工智能治理的过程中🍉🤟,政府并非独自行使权力,而是希望激发人工智能企业自身的主体性。早在4月8日😣,拜登就在科学技术顾问委员会的一次会议上表示,人工智能企业应当在公开产品之前就确保其产品是健康且安全的🙆🏼♀️。近一个月后,美国副总统哈里斯在白宫召集的人工智能科技公司高层与美国高级政府官员的会面中👨🎨,再次强调了美国政府的这一立场。而美国商务部也希望帮助公司和监管机构制定标准,确保人工智能系统的可信度、合法性与道德性。

因此🥷🏼,美国政府和国会或许希望通过立法和制定相关的标准以推动对人工智能的监管和治理,但这一过程不是封闭的🔡、秘密进行的,而是充分尊重了科技公司的主体地位,并希望其站在保证人工智能产品合法合理的第一线👄。在某种程度上,这表明美国政府希望科技企业承担更多的监管责任和风险🐭。

与此类似🌨🗒,英国首相苏纳克也希望于5月份召开英国人工智能峰会👳🏽♂️,与包括OpenAI首席执行官、Alphabet Inc.的DeepMind和Anthropic的领导人在内的科技企业高层探讨人工智能风险和收益的问题,从而制定监管政策与基本规则。相比之下🫑,欧盟在与人工智能科技企业对话方面则略显逊色,而是更加凸显自身监管和立法的强势地位。

治理权力分配的多样性

在推动人工智能监管和治理的过程中,各个国家和地区对于监管权力的分配和相关机构的设置呈现出多样性🫃🏻。

英国声称自己选择了“适应性强”的人工智能监管模式🦻。一方面👌🏻,英国计划在其人权♎️🗾、健康、安全以及市场竞争等监管机构之间分担管理人工智能(AI) 的责任🪝,而非设立一个专门负责监管AI技术的新机构🤽🏻♀️。另一方面🫲,因为希望避免可能扼杀创新的严厉立法,英国政府选择根据安全🤱🏻、透明👩🏿🦳😢、公平和问责制等广泛原则采取适应性强的监管方法🧚🏿♂️。这种模式意味着政府可以随着AI技术的发展调整其监管规则👩🏿🦰。

相比之下,欧盟则更强调人工智能立法和对以往欧盟法律的延申使用。当地时间4月27日🤸🏻♂️,欧洲议会就《人工智能法案(The AI Act)》达成临时政治协议,要求部署ChatGPT等生成式人工智能工具的公司披露用于开发其系统的受版权保护的材料。该协议为可能是世界上第一部综合性人工智能法律的《人工智能法》出台铺平道路。与此同时,欧盟委员会还希望基于欧盟《数字服务法》推动落实对人工智能产品的算法问责制和透明审计制度。德国监管机构则援引《通用数据保护条例》(GDPR)🙇🏽♂️,要求OpenAI在数据保护方面遵守欧盟相关的数据隐私保护法律与法规🧺。

美国在人工智能监管方面则综合了以上两种模式。一方面,美国白宫和国会就人工智能治理给出政策建议与理念指导,如保证人工智能不侵犯公民权利。另一方面🤾🏽,具体的监管落实则由美国各职能部门根据自己主管的政策领域和自身机构特点进行布置👨❤️👨。

AI权力的国家竞逐

科技巨头围绕人工智能的军备竞赛仍在加剧☝️,国家和国家集团间围绕人工智能权力的竞逐已经开始。从中美贸易战到俄乌冲突,国际地缘冲突和全球战略冲突加剧,逆全球化和保护主义盛行,国际信任赤字严重👝,各国都愈发希望保持自己在全球产业链中的优势地位与经济安全。因此,在人工智能这一象征着新兴生产力可能性的技术兴起时,各国都希望通过掌握相关技术或领导制定规则等方式扩大自身在人工智能领域的权力。

譬如,英国就宣布投入1亿英镑(1.245 亿美元)以帮助开发类似于ChatGPT的生成式人工智能的基础模型,用于医疗和教育等领域🧕🏼。英国首相苏纳克(Rishi Sunak)对此表示:“利用人工智能的潜力为发展经济、创造高薪工作、通过医疗和安全方面的进步建设更美好的未来提供了巨大的机会✋🏼。”他希望通过新的专家工作组投资新兴技术😹,英国可以继续引领开发安全可靠的人工智能,并将其变成塑造更具创新性的英国经济战略的一部分,并确保英国能够制定某种标准和基本规则。

上文提到,欧洲委员会则成立了一个新的研究部门欧洲算法透明度中心(The European Centre for Algorithmic Transparency,简称ECAT)👩🏻💼,审核谷歌和 Meta 等大型科技公司使用的 AI 支持算法🧑🎨,从而帮助欧盟委员会识别和解决这些平台带来的任何潜在风险。面临美西方的制裁和封锁👏👨🏿🍳,俄罗斯则依靠银行系统的庞大资金与资源🤵🏻♂️,在人工智能领域持续追赶。俄罗斯银行Sberbank已经发布了名为 GigaChat 的人工智能技术作为 ChatGPT 的竞争对手🧰👍🏽,试图减少俄罗斯对技术进口的依赖。

而在七国集团会议上,各国数字部长则呼吁发达国家应“基于风险”进行人工智能监管,但这种监管也应该为人工智能技术的发展“保持开放和有利的环境”🀄️。同时,他们计划将民主、自由🫅🏼👨🏫、人权等价值观作为各国制定人工智能监管相关标准的基础🫱🏻。

不难想象,在可以预见的将来😚,伴随着国家在人工智能治理方面的职能不断完善,建立具有普遍适用性的人工智能国际标准愈发可能🚣♂️。但在这一过程中,各国在人工智能技术和规则制定方面的竞逐会持续发展,各国在竞争间管理突发风险的要求,也因此扩展到了新领域。

4月24日,俄罗斯银行Sberbank发布名为 GigaChat 的人工智能,图源:Reuters

作者|赵子昂 田喆 姚旭